Pernahkah unggahan konten Anda di platform media sosial--entah itu Facebook, Instagram, Twitter, atau YouTube--terhapus karena dianggap melanggar kebijakan dan peraturan?

Kalau pernah, ada dua kemungkinan penyebabnya. Anda memang sengaja mengunggah konten yang tidak pantas, atau... konten yang Anda unggah sebetulnya baik-baik saja tapi entah kenapa kok dianggap sebagai suatu pelanggaran ya...

Dan juga, pernahkah Anda bertanya-tanya, siapa yang sebetulnya menghapus konten itu dan yang menentukan baik-tidaknya peredaran konten di media sosial?

Saya baru mengalaminya sekali, sih. Waktu itu saya mengirim pesan teks lewat Facebook yang berisi kata-kata "PKI". Teks itu terhapus begitu saja. Saya dianggap melanggar ketentuan.

Saya heran dan tertawa sinis dalam hati. Lha, sebelah mana salahnya? Teks yang saya ketik tidak ada sangkut-pautnya dengan tendensi provokatif maupun mendiskreditkan pihak tertentu.

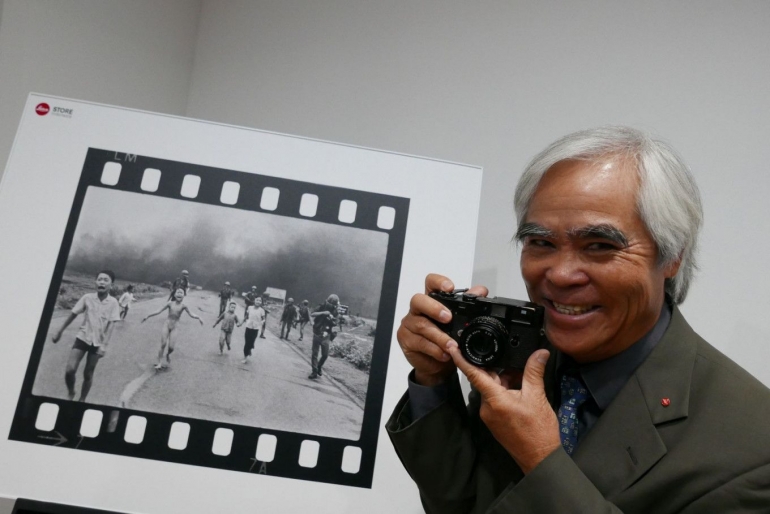

Keanehan semacam ini pernah dialami seorang penulis Norwegia, Tom Egeland, pada 2016 lalu. Ia mengunggah foto jepretan Nick Ut, fotografer Associated Press, yang ikonik itu; foto gadis kecil telanjang yang berteriak dan mencoba melarikan diri dari hantaman perang Vietnam tahun 1972.

Foto itu sarat dengan historisitas dan memperoleh penghargaan Pulitzer Prize. "Seven photographs that changed the history of warfare", tulis Egeland untuk unggahannya di Facebook. Namun Facebook menghapusnya dengan alasan "untuk menghentikan pornografi dan kekerasan". Ketika Egeland mengeluh tentang sensor ini, akun Facebook-nya di-suspend.

Tindakan sensor Facebook waktu itu sempat dikecam editor dan CEO media Aftenposten, Espen Egil Hansen. Ia melayangkan protes kepada Mark Zuckerberg dan mengkritisi cara "editorial" Facebook yang kacau.

Dalam film The Cleaners (2018), foto karya Nick Ut itu juga muncul sebagai pemantik isu. Sutradara Jerman, Hans Block dan Moritz Riesewieck, menyorot suatu adegan di mana seorang moderator konten tengah menimbang keputusan di depan komputer, apakah foto karya Nick Ut layak tayang di Facebook atau tidak.

Sang moderator sebetulnya tahu belaka kalau foto itu ikonik, tapi toh dihapus juga karena dianggap melanggar peraturan--semata-mata karena foto itu telah menampilkan tubuh gadis kecil yang telanjang.

Seorang moderator konten dalam The Cleaners menjelaskan bahwa foto itu memberi kesan eksploitasi tubuh anak kecil yang sudah mati, jadi sudah pasti harus dihapus dari Facebook.

Block dan Riesewieck tak berhenti pada narasi si moderator. Seolah tak puas dan coba menyeimbangkan argumen, The Cleaners membawa mata penonton ke hadapan Barakeh, sang pemilik foto.

Dalam scene, Barakeh tengah menguliti siluet tubuh pada foto yang sudah dicetak dengan pisau lipat hingga menyisakan sebagian ruang putih kosong. Semacam upaya penyensoran yang dilakukannya sendiri. Ia ingin karyanya tetap bisa diunggah meskipun yang terlihat hanyalah siluet tubuh korban.

Gore bilang, "Gambar itu hanyalah representasi dan bukan kenyataan". Tetapi menurut seorang moderator, "Gambar itu mendiskreditkan Trump secara personal, jadi harus dihapus".

Bagi Anda yang belum melihat sengkarut problem pada raksasa teknologi di Silicon Valley itu, beberapa kasus tadi--yang saya potong framing-nya untuk, katakanlah, bumbu pembuka tulisan ini--tentu saja membuat Anda kesal dan gemas belaka dengan ulah si moderator. Tapi tunggu dulu, permasalahannya memang tidak sesederhana itu.

Kerja Suram Moderator Konten Media Sosial: Bertaruh dengan Penyakit Mental

"Alasan saya mau berbicara kepada Anda karena dunia harus tahu bahwa kami di sini. Kami yang selalu mengecek media sosial. Kami lakukan yang terbaik untuk menjaga platform ini tetap aman untuk mereka semua."

Kalimat pembuka The Cleaners terngiang-ngiang di kepala saya. Kira-kira begitulah yang dikatakan seorang moderator anonim.

The Cleaners memotret kerja moderator konten yang direkrut melalui perusahaan outsourching di Manila, Filipina. Seorang moderator mengaku, dalam sehari ia bisa meninjau kira-kira 25.000 konten. Ia bahkan berseloroh, "Saya bisa memecahkan Guiness Book of Records".

The Cleaners atau Im Schatten der Netzwelt (2018) dalam bahasa aslinya, menjadi nominasi Sundance Film Festival dan memenangkan penghargaan lainnya seperti It's All True - International Documentary Film Festival. Film ini berhasil menyuarakan sisi gelap perusahaan teknologi raksasa yang - jika tak berlebihan--selama ini dipuja-puji sebagai revolusi 4.0.

Film garapan Block dan Riesewieck ini mengambil latar kantor yang tidak sebenarnya. Mereka menyetting suasana kantor sedemikian rupa; mengambil mantan moderator sebagai narasumber yang diposisikan pada adegan bagaimana cara mereka bekerja di dalam bilik-bilik kubikel, berhadapan langsung dengan layar komputer.

Keberadaan outsourching di Manila ini tersembunyi. Sutradara memperoleh penolakan dari perusahaan untuk merekam gambar di kantor yang sebenarnya.

Bahkan untuk menyusup dengan kamera tersembunyi saja sulit. Para moderator juga punya perjanjian khusus pada perusahaan agar tidak membocorkan informasi.

Dalam wawancara oleh CBC News Block bilang, "Bagaimana bisa kamu membuat film tentang industri yang benar-benar tertutup. ... Jadi kami harus menemukan solusi untuk mentransformasi suasana bekerja yang sebenarnya dan makna bekerja di dalam film."

Di awal scene, kita akan mendengar racauan mereka saat berhadapan dengan komputer: "Ignore... delete... delete... ignore... delete... ignore..." dan seterusnya.

Kita juga mendengar suara "klik" secara teratur dari mouse komputer, semacam "tanda" dari keputusan demi keputusan yang mereka ambil. Keputusan untuk menghapus atau membiarkan konten akan berdampak serius bagi kehidupan di berbagai penjuru dunia, dari Filipina sendiri, Myanmar, Turki, AS, dan penjuru negara lain yang belum sempat direkam dokumenter The Cleaners.

Kamera menyorot ke sepasang mata moderator dari dekat, seolah-olah lewat mata itu kita bisa merasakan ketegangan demi ketegangan yang mereka alami. Hampir setiap hari mata itu terpapar konten-konten kekerasan, mulai dari ujaran kebencian, cyber bullying, self-harm, bunuh diri, pornografi, kekerasan seksual, kekerasan pada hewan, pembunuhan, hingga terorisme.

Seorang moderator lain bahkan mengaku, "Saya sudah melihat ratusan video pemenggalan kepala". Ia dengan fasih mengidentifikasi sebuah foto mayat mutilasi--kamera The Cleaners sengaja membuatnya tampak blur--mana pembunuhan yang dilakukan dengan pisau tajam dan mana yang dilakukan dengan pisau tumpul.

Seorang moderator perempuan bercerita bahwa pekerjaan ini telah "mengajarinya" apa-apa yang berhubungan dengan kegiatan seksual. Semula ia benar-benar polos dalam hal ini hingga malam-malamnya dipenuhi dengan mimpi buruk sekaligus dipenuhi kepuasan seksualitas.

Kontras dengan itu, sutradara menyorot sisi religiusitas yang dipegang kuat oleh si moderator perempuan ini. Ia menganggap, tugas meninjau konten kekerasan jadi semacam tugas mulia yang harus diembannya. Ia percaya telah membersihkan dosa-dosa yang tak seharusnya dilihat oleh jutaan orang lain lewat "pengorbanan dirinya sendiri".

Ada juga seorang moderator laki-laki yang merasa bangga dengan pekerjaan ini dengan dalih "kami seperti polisi, sudah menjaga dunia dari konten-konten yang tidak diinginkan". Namun ketika ia mengatakan itu, sorot matanya menyimpan sesuatu yang lain, semacam luka yang mengeras dan coba ditepisnya.

Moderator perempuan yang lain sangat trauma dengan adegan kekerasan yang terjadi pada anak-anak. Ia merasa tak tahan dengan ini, tetapi atasannya bilang, ia harus melakukan pekerjaan ini karena sudah jadi tanggung jawabnya dan terlanjur menandatangani kontrak.

Block dan Riesewieck kemudian menyorot latar tempat pembuangan sampah di Manila. Moderator perempuan yang kedua ini bercerita tentang pesan ibunya; ia harus bersekolah agar tak bernasib seperti pemulung sampah.

Ia takut sekali jika hidupnya berakhir sebagai pemulung. Menurutnya, gaji di Filipina sangat kurang dan bekerja sebagai moderator konten seperti memberi harapan baru.

Saya memaknai scene itu secara tersirat, seolah-olah sutradara ingin bilang bahwa nyaris tak ada beda antara bekerja sebagai moderator media sosial yang berkantor di gedung pencakar langit dengan pemulung sampah betulan. Keduanya sama-sama berurusan dengan "sampah".

Gambaran itu jadi semacam alegori atas tragedi yang (harusnya) menampar era kecanggihan teknologi. Dalam bahasa lain, moderator sosial media adalah buruh-kasar dalam wajah modernitas yang selama ini jadi aib dan harus disembunyikan.

Tugas mereka membersihkan sampah dan kotoran media sosial tanpa dibekali dengan pengetahuan yang cukup, entah itu kekritisan ala jurnalistik, keterampilan bahasa, maupun wawasan budaya negara lain yang kelak akan terkena imbasnya.

Hak sebagai pekerja berbanding terbalik dengan risiko fatal yang harus mereka tanggung; trauma berkepanjangan dan berbagai kemungkinan penyakit mental.

Laporan Washington Post pada Juli 2019 lalu mengatakan, dibandingkan dengan cabang outsourching lainnya di AS atau India yang menyaring konten media sosial dalam negerinya sendiri, moderator di Filipina mengevaluasi gambar, video, dan unggahan dari seluruh dunia.

Kondisi itu sangat rentan sebab mereka hanya menguasai bahasa Tagalog dan Inggris. Mereka mengandalkan Google Translate--yang sejatinya tak bisa diandalkan--untuk meninjau 10 bahasa yang tak dikuasai betul. Belum lagi, konteks budaya negara lain yang tak mereka pahami. Ini membuat mereka semakin tertekan.

Perusahaan teknologi raksasa, seperti Facebook, Google, YouTube, Twitter, mengandalakan kerja sama perusahaan outsourching, sebagian yang punya titel "profesional" misalnya Accenture dan Cognizant, untuk menangani "sampah-sampah" yang dihasilkan media sosial.

Perusahaan outsourching yang bekerja sama dengan Facebook tersebar di 20 negara, termasuk Latvia dan Kenya. Filipina dan India adalah cabang yang paling besar.

Tapi, apakah dengan begitu perusahaan outsourching di AS bisa dikatakan steril dari praktik-praktik kerja yang tak sehat? Jawabannya, tidak juga.

Casey Newton membuat laporan panjang di The Verge soal kondisi moderator di Phoenix pada Februari 2019. Setelah itu, ia menerima banyak pesan dari para moderator-kontrak yang memiliki pengalaman buruk, paling banyak dari Tampa, Florida. Dari informasi narasumbernya di Phoenix, diduga kuat bahwa kondisi di Tampa lebih suram.

Pada Juni 2019, Newton akhirnya meluncurkan hasil investigasi outsourching di Tampa itu lewat The Verge. Muncul berita yang paling tak sedap. Seorang moderator berusia 42 tahun terkena serangan jantung saat bekerja di mejanya.

Nyawanya tak tertolong. Peristiwa itu terjadi pada Maret 2018. Perusahaan di Tampa itu, Cognizant, lebih banyak bungkam dan hanya memastikan kepada para pekerja bahwa "semuanya akan baik-baik saja" sembari menyimpan kecemasan terhadap stabilitas dan dampak emosional yang dialami mereka.

Newton mewawancarai 12 mantan moderator dan yang masih menjalani kontrak kerja saat itu, juga manajer perusahaan di Tampa. Tiga mantan moderator bersedia membuka identitasnya kepada publik demi mendiskusikan kondisi yang terlanjur buruk ini. Seorang di antaranya, Shawn Speagle, mengalami PTSD (Post-traumatic Stress Disorder).

Selain trauma dan gangguan psikologis yang dialami karena melihat konten kekerasan sepanjang hari, mereka juga bercerita tentang lingkungan kantor yang tak sehat.

Mereka diberi waktu istirahat dua kali 15 menit dan makan siang 30 menit, serta 9 menit per hari untuk "wellness time"--sekadar "bernafas" dan melepaskan beban emosional saat bekerja.

Kantor sering dalam keadaan kotor. Secara berkala, mereka menemukan upil, potongan kuku, dan pubic hair di sekitar meja kerja yang digunakan secara bergantian dari shift ke shift.

Bagian yang paling menyedihkan, manajernya tertawa ketika mendengar aduan dari pekerja yang mengalami pelecehan dan ancaman kekerasan seksual. Sejak April, dua kasus diskriminasi telah diajukan ke Equal Employment Opportunity Commission--semacam komisi pemerintah yang mengurusi kasus ketidakadilan pada pekerja.

Itu baru secuil cuplikan yang saya comot. Belum lagi tentang protes para moderator di India karena menerima upah rendah sementara tekanan kerjanya sangat besar di Februari 2019 lalu. Anda bisa baca selengkapnya di Reuters. Berita tentang moderator di Filipina via Washington Post dan di AS via The Verge tadi (ini dan ini).

Jika Newton memberitakan soal kematian moderator outsourshing di Tampa, The Clenaers juga menyinggung itu pada akhir cerita. Seorang psikolog bercerita tentang penyesalannya karena gagal menyelamatkan nyawa seorang moderator.

Ia berusaha membujuk perusahaan untuk menangani masalah ini sebanyak tiga kali, tapi diabaikan.

Moderator itu ditemukan tewas di kamarnya, menggantung dirinya sendiri dengan tali. Di hadapannya ada laptop yang masih terbuka dan menyala. Kematian itu enggan diungkit perusahaan.

Mei 2019 lalu, Facebook mengumumkan bahwa mereka akan menaikkan upah pekerja kontrak, menyediakan konselor selama jam operasi kerja, dan mengembangkan program lainnya untuk pekerja kontrak. Tapi kenaikan upah tampaknya baru bisa berlaku di pertengahan 2020.

Sementara konselor untuk penanganan efek psikologis para moderator belum bisa dipastikan. Outsourching Accenture tampaknya sudah menjalankan layanan ini, seperti diwartakan The Intercept, itu pun masih bermasalah.

Merujuk laporan The Verge lagi, kabarnya Facebook tengah membangun "tim ketahanan global" untuk meningkatkan kesejahteraan pekerja penuh dan kontrak.

Seorang yang memimpin tim ini, Chris Harrison, mengungkapkan rencananya mengembangkan fitur baru untuk kenyamanan kerja moderator yang bisa membuat gambar atau video blur secara otomatis atau membisukan audio.

Saya tak paham betul sih seluk-beluk IT, tapi suka bertanya-tanya, adakah perusahaan IT yang mengedepankan workers experience alih-alih memborbardir visi bisnisnya dengan user experience lagi dan lagi?

Meski tak bisa dijamin seratus persen dan bukan satu-satunya solusi, apakah fitur baru yang dikatakan Harrison itu ampuh mengurangi tingkat penyakit mental para moderator, setidaknya mereka mendapatkan perhatian penuh.

Juga, apakah penyediaan konselor bagi moderator yang jumlahnya ribuan itu--entah yang masih dalam kontrak atau yang sudah putus kontrak--bisa terwujud, terutama untuk outsourching di luar AS?

Ini benar-benar PR yang sulit mengingat jangkauan kontrol yang jauh dari Silicon Valley dan sistem outsourching tak menjamin kebijakan yang datang dari pusat itu terpenuhi.

Dilema Konten Media Sosial: Tarik-menarik Bisnis, Jurnalisme, dan Politik

The Cleaners tak berhenti pada cerita personal tentang pengalaman-pengalaman buruk moderator. Dokumenter ini menarik batas itu, memperluasnya jadi diskusi yang apik dan kritis.

Dua mantan pekerja di Silicon Valley, ahli dan pengamat dari universitas, jurnalis, blogger, seniman, aktivis NGO, hingga aktivis sayap kanan ambil bagian di dalamnya.

The Cleaners menampilkan beberapa cuplikan perwakilan dari Facebook, Google, dan Twitter sebagai saksi di persidangan soal pemilu AS 2016. Sidang ini diadakan tahun 2017.

Seorang Senator bertanya tentang kekhawatiran atas interpretasi publik yang awam terhadap konteks pada akun-akun media sosial, misalnya mana akun yang terindikasi teroris dan mana yang bukan. Ini bukan wilayah teknikus semata, "Siapa para ahli konten ini?"

Jawaban para perwakilan perusahaan Silicon Valley ini mirip politisi, terlalu banyak retorika alih-alih menjawabnya dengan valid. Kalau disederhanakan, jawaban perwakilan Facebook kira-kira begini, "Kami punya ribuan pekerja, mereka bisa menonaktifkan akun yang terindikasi teroris".

Lalu, perwakilan Twitter kira-kira bilang begini, "Kami punya sistem algoritma yang bisa membantu kami". Sementara perwakilan Google kira-kira begini, "Kami bekerja sama dengan perusahaan lain yang bisa menangani masalah konten ini".

Pernyataan Facebook dan Google itu mungkin bisa diterjemahkan dengan: bahwa jumlah pekerja yang ribuan orang itu sebagian besar dikontrak melalui perusahaan outsourching dan berkantor di luar Silicon Valley.

Seperti yang disebut Washington Post, malam sebelum mereka bersaksi di persidangan, Mark Zuckerberg mengumumkan bahwa Facebook akan mempekerjakan 10.000 orang baru di bidang keselamatan dan keamanan untuk meninjau konten.

Sebulan kemudian, YouTube dan Google menjanjikan 10.000 orang untuk akhir 2018. Twitter menjanjikan 1.500 pekerja untuk tahun 2018.

Tapi apakah moderator ini, yang disebut oleh Facebook sebagai "peninjau konten untuk bidang keselamatan dan keamanan", betul-betul "ahli" menangani konten media sosial?

Bisakah secuil kasus yang saya deskripsikan di permulaan paragraf bisa dihindari? Bisakah sistem algoritma yang mereka jalankan menyaring konten dengan lebih objektif?

Sekarang kita tahu belaka bahwa algoritma yang mereka rancang benar-benar meracuni dunia. Keterpilihan presiden AS dan Filipina misalnya, peran masif algoritma "kawin" dengan wacana post-truth. Contoh lain yang paling dekat, kebisingan polarisasi pilpres Indonesia beberapa bulan yang lalu, bahkan sekarang gemanya masih tersisa di sana-sini.

Beranda media sosial kubu A selalu dipenuhi argumen-argumen "kebenaran" versinya sendiri. Begitu pula yang terjadi pada kubu Z. Suara kebenaran versinya masing-masing terus menggema dan memantul balik di ruang media sosial. Bisakah para raksasa teknologi mengatasi segala kekacauan itu?

Ironi sekali ketika sebagian besar masyarakat Myanmar menganggap kalau "internet adalah Facebook". Kebanyakan dari mereka bahkan tidak tahu apa itu e-mail.

Mayoritas masyarakat Myanmar membenci Rohingya dan ketika algoritma Facebook menyediakan ruang-gaung kemarahan dari setiap orang, kekerasan tak terhindarkan. Begitulah yang dikatakan seorang blogger Myanmar dalam The Cleaners.

Para moderator dalam The Cleaners mengaku, mereka punya daftar organisasi teroris dari pihak Keamanan dalam Negeri di AS. Tapi, bisakah mengandalkan satu sumber resmi saja?

Seorang aktivis NGO dalam The Cleaners mengatakan bahwa rekaman-rekaman terorisme atau kekerasan jenis lainnya yang beredar di media sosial punya sisi "manfaat" untuk membantunya dalam bekerja.

Para aktivis harus secepat mungkin menyimpan bukti itu sebelum dihapus dari media sosial, untuk selanjutnya menjadi bahan identifikasi dan investigasi yang mereka lakukan.

Nicole Wong, mantan pembuat kebijakan Google dan Twitter, mengakui kesulitan dalam memahami "konteks" dalam konten yang jumlahnya tak terhitung itu.

Apakah itu masuk dalam berita pers atau sengaja dibuat untuk memprovokasi, apakah itu masuk dalam kritik atau komentar, dan seterusnya. Keputusan untuk menghapus atau membiarkan suatu konten tidak bisa diterjemahkan dengan cara mesin otomatis.

Inilah yang jadi soal, kenapa foto karya Nick Ut bisa terhapus dari Facebook. Moderator gagal memahami konteks. Untuk kasus Khaled Barakeh dan Illma Gore, kita bisa dan harus berdebat panjang.

Berbeda dengan foto jepretan Nick Ut yang telah melewati pertarungan wacana sebelum internet berkembang masif, karya Barakeh dan Gore tak bisa sekadar diuji lewat unggahan Facebook yang punya penilaian mekanis, seperti jumlah viewers, like, dan share.

Bahkan meja redaksi pers saja perlu melewati perdebatan sengit sebelum memutuskan apakah karya si seniman layak dipublikasi atau hanya disimpan saja. Memahami konteks nyatanya harus melampaui kemampuan mekanis.

Dalam The Cleaners, mantan Manajer Produk di Facebook memberi pendapat kritisnya soal ini. Ia pernah bekerja di Facebook ketika masih muda.

Ia bilang, pada dasarnya Facebook adalah perusahaan teknologi yang dijalankan oleh para teknikus; ini tentang produk, tentang infrastruktur, tentang user experience, dan bukan tentang perusahaan media atau content creation atau content editing.

Jadi, ketika orang-orang berseru menuntut pertanggungjawaban Facebook, mereka bisa saja berdalih dengan, "Hei, sistem kami hanyalah algoritma dan perusahaan kami bekerja dengan matematis dan mekanis".

Tapi dalam realita politiknya, kita memperoleh fenomena mengejutkan pada kasus pemilu AS, Filipina, bahkan Brexit, dan negara lainnya seperti Indonesia. Fenomena ini tak bisa disangkal lagi oleh raksasa teknologi semacam Facebook--yang mau tak mau, harus mereka tuntaskan problem serius ini.

Lucunya, para raksasa ini melakukan tindakan blokir IP-Address sesuai permintaan otoritas Turki. Nicole Wong, sebagai mantan petinggi di Silicon Valley, mengakui ini.

Pers dibungkam oleh pemerintah sementara platform media sosial yang diharapkan bisa menembus keotoriteran tak bisa diandalkan, sebab yang dipikirkan mereka adalah bisnis. Bisnis tetaplah bisnis, yaitu mencari keuntungan sebanyak-banyaknya.

Nicole Wong bercerita, di masa awalnya bergabung dengan raksasa teknologi ini, ia merasa bangga sebab punya semacam kesamaan "visi kebebasan" pada platform yang tengah mereka bangun. Kebebasan di mana Anda dan kita semua terkoneksi dalam satu data tanpa batasan waktu.

Saya jadi teringat slogan Partai dalam novel 1984. Begini bunyinya:

"Perang ialah damai. Kebebasan ialah perbudakan. Kebodohan ialah kekuatan."

Dunia ciptaan George Orwell semakin tampak mendekati relevansi. Seandainya Orwell masih hidup di era 4.0 ini, mungkinkah ia menulis novel seperti 1984 lagi tapi dalam versi lain? Misalnya diberi judul 2091, begitu? Jika slogan dalam novel Orwell itu mendekati relevansi masa sekarang, lalu siapakah yang jadi "Bung Besar"-nya?

Oh, ya. Kabarnya Facebook membentuk dewan pengawas konten. Fungsinya sebagai pengadilan independen yang akan membuat keputusan untuk konten. Diperkirakan berjalan pada 2020.

Apakah Facebook dan platform media sosial lainnya akan bahu-membahu memperkuat pers untuk mengecek fakta atau malah menggeser peran pers? Lalu, bagaimana nasib moderator konten--entah yang masih bekerja maupun yang sudah putus kontak dan harus menanggung dampak psikologis sendirian?

Kita lihat nanti.